从统计学角度来看深度学习(3):记忆和核方法

统计之都发表于 2015-06-25 12:49:15

原文链接:http://blog.shakirm.com/2015/04/a-statistical-view-of-deep-learning-iii-memory-and-kernels/

连接机器学习的回归方法

人们通过对以往的经验或者数据的回忆来推断未来的事物,这样的过程可以用一个经常出现在最近文献中的词语——记忆来概括。机器学习模型都是由这样的‘记忆’组成的,如何理解这些‘记忆’对于如何使用模型是极为重要的。根据机器学习模型的种类,可以分为两种主要的记忆机制,即参数型与非参数型(还包括了介于两者之间的模型)。深度网络作为参数记忆型模型的代表,它将统计特性从所观察到的数据中以模型参数或者权重的方式提炼出来。而非参数模型中的典范则是核机器(以及最近邻),它们的记忆机制是存储所有数据。我们可以自然地认为,深度网络与核机器是两种原理不同的由数据推导结论的方法,但是实际上,我们研究出这些方法的过程却表明它们之间有着更加深远的联系以及更基本的相似性。

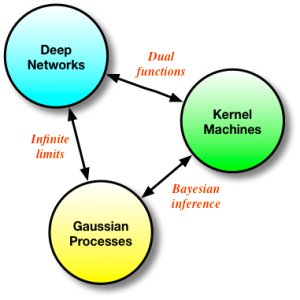

深度网络、核机器以及高斯过程三者形成了解决相同问题的一套连贯的方法。它们的最终形式很不相同,但是它们本质上却是相互联系的。了解这一点对于更深入的研究十分有用,而这种联系正是这篇文章将要探讨的。