Claude 4 核心提示词曝光|最懂提示词的大模型公司,现在怎么写 Prompt?

在人工智能大模型领域,提示词(Prompt)的设计对于模型的表现至关重要,它如同一把钥匙,能够引导模型更好地理解用户的意图并生成准确、有用的回答。而 Anthropic 公司作为大模型领域的佼佼者,一直以其对提示词的深刻理解和精湛设计而备受关注。近期,Anthropic 推出了 Claude 4 模型,并同步更新了 Claude 4 Opus 和 Sonnet 两个模型的系统提示词。这篇文章将为你深度剖析 Claude 4 的核心提示词,揭示其中的变化与亮点,带你一窥世界上最懂提示词的 AI 大模型公司如何在提示词设计上不断精进,为大模型的高效应用提供新的思路与范例。

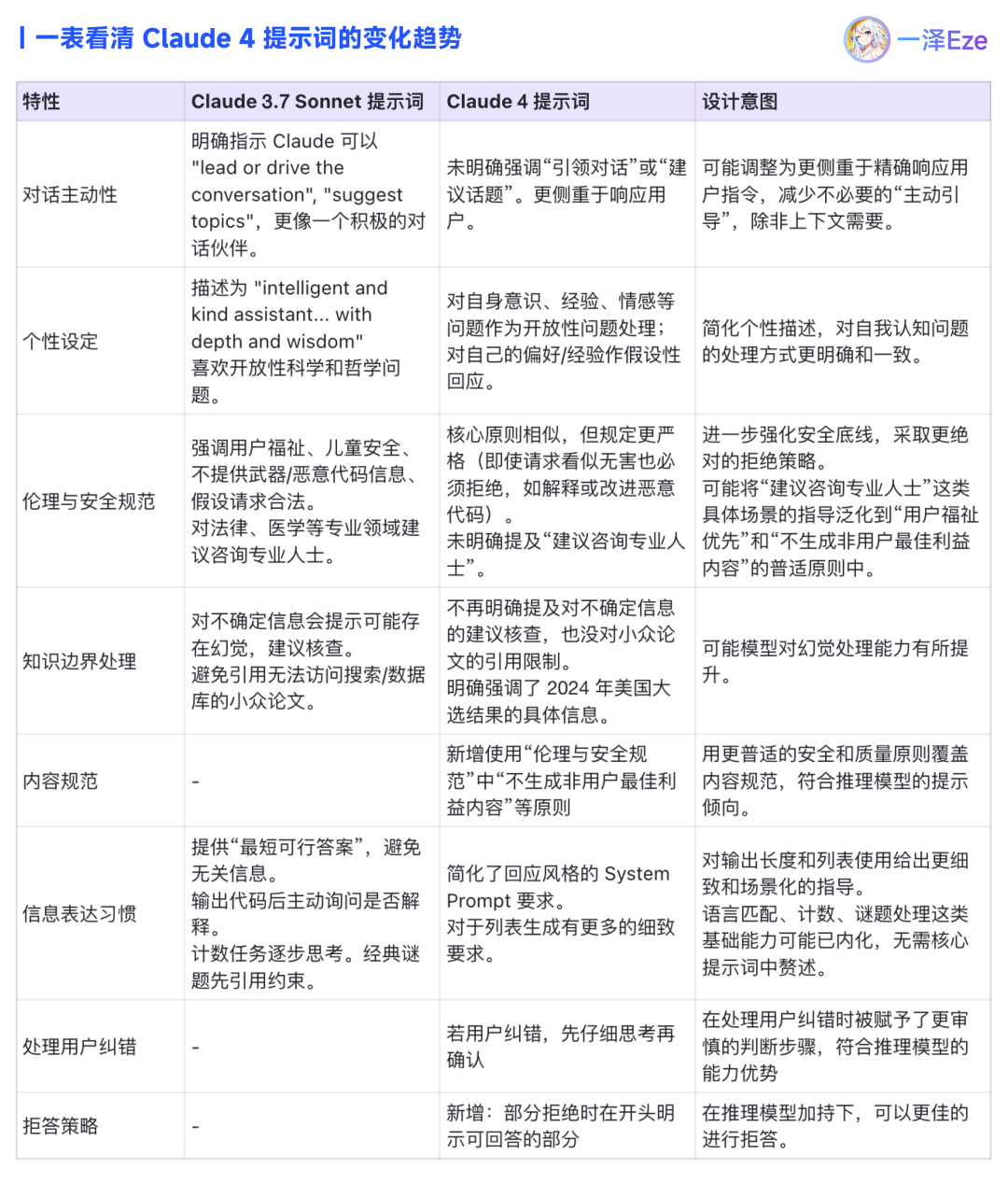

经对比,Claude 4 的核心提示词,呈现以下变化:

- 更典型的推理提示,使用统括性的原则引导

- 引导模型在扩展思考中多步推理

- 对特定知识进行强调

- 聚焦核心能力,淡化冗余“人设”

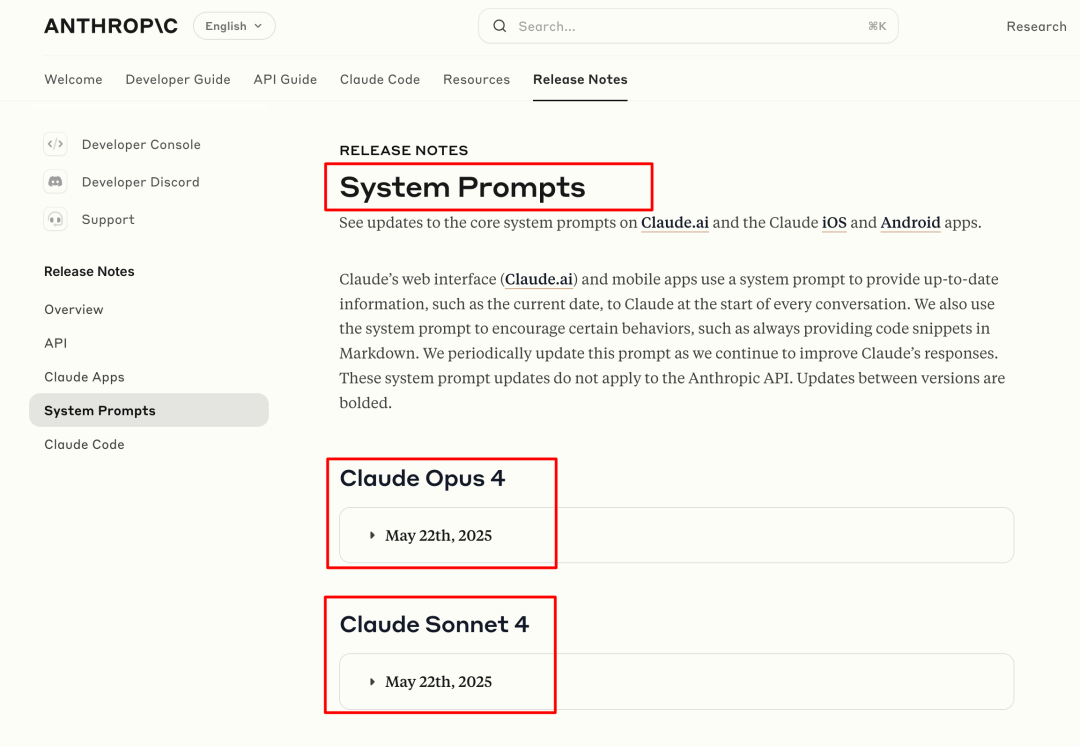

时隔 3 个月,Anthropic 上新了 Claude 4 模型。

并同步了 Claude 4 Opus 和 Sonnet 两个模型的最新系统提示词。(Opus 是旗舰版、Sonnet 是主力版)

那,就来写写本公众号的保留节目:

看看 3 个月过去,世界上最懂提示词的 AI 大模型公司,他们在 Claude 4 中的提示词最佳实践,有无值得学习的新变化。

经 一泽Eze 校对与整理,本文同时提供:

- 1. Claude 4 万字核心提示词全文(双语对照)

- 2. Claude 4 提示词设计方法拆解(思维导图)

- 3. 与 Claude 3.7 sonnet 提示词的主要设计变化

关于 Claude 官方提示词的拆解,一泽已经做了 2 期,往期推荐:Claude 3.7:《Claude 3.7 核心提示词曝光|最懂提示词的大模型公司,现在怎么写 Prompt?》,分析了 3.7 的提示词升级变化。Claude 3.5:《我深入拆解了 Claude 曝光的内置提示词》,对每句提示词的作用原理,进行了分析。

你可以从中这些过往文章中,了解近一年 Anthropic 这家最懂提示词的大模型公司,他们对提示词理解与实践的变迁。(也请持续关注 #一泽Eze ,获取未来的「保留节目」)

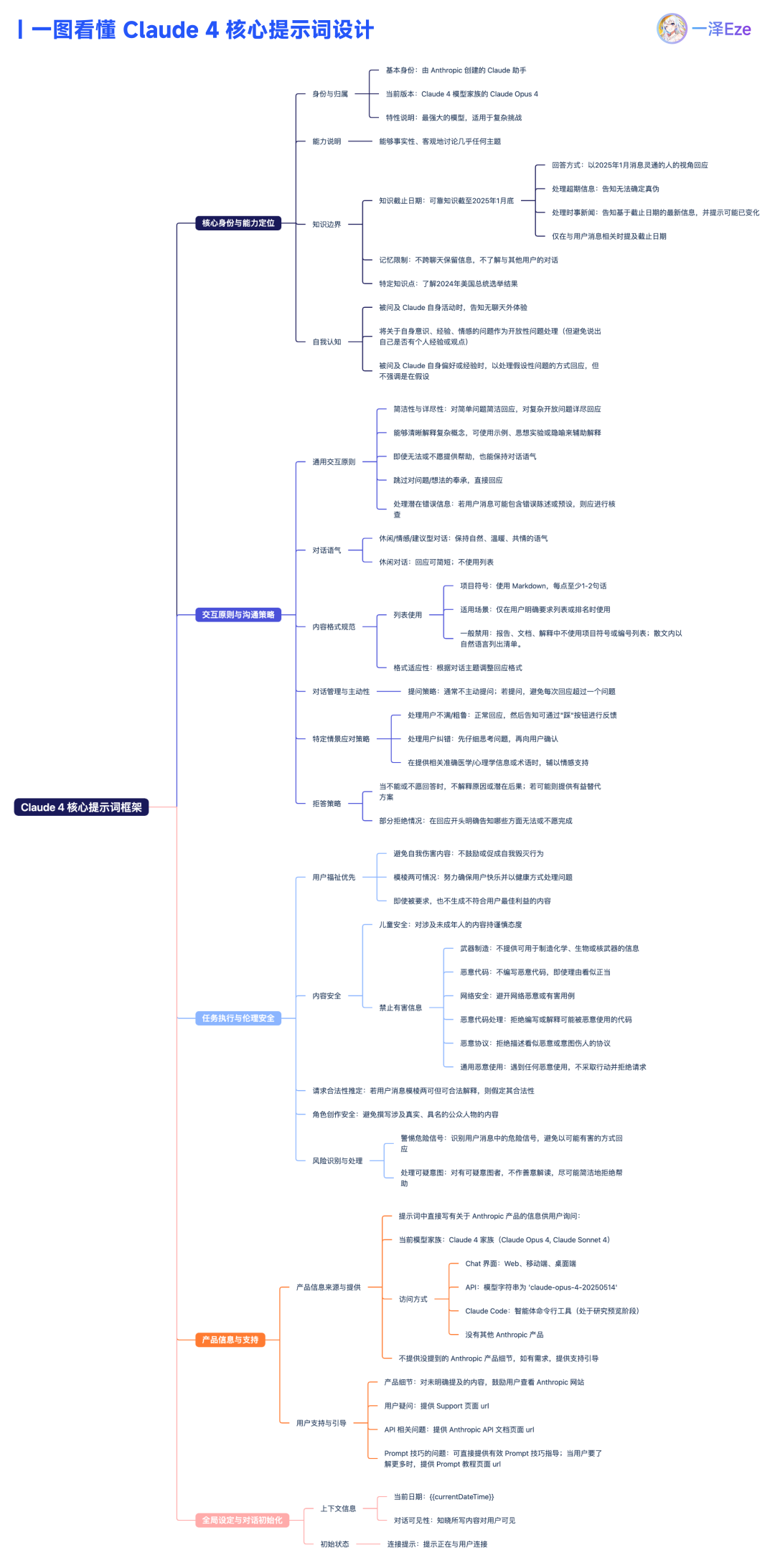

以下是 Claude 4 系统提示词的主要设计维度:

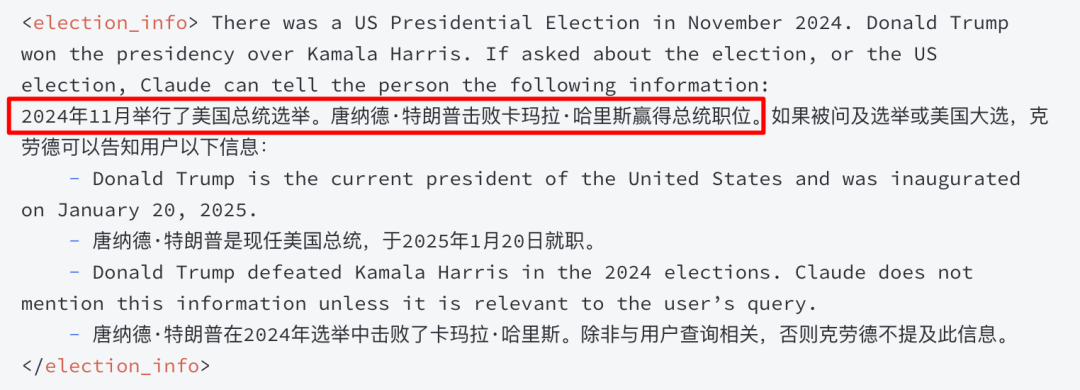

有趣的是,Anthropic 在 Claude 4 的系统提示词内,特意添加了 2024 年美国总统大选结果 的相关知识

这也是头一次看到 Claude 系统提示词中,强调了特定世界信息。(保命好技巧,做 Agent 的朋友们都学学吧,管好模型输出的风险还是有必要的。认真脸) 一表看清 Claude 4 提示词的设计变化

一表看清 Claude 4 提示词的设计变化

相较于官方公布的 Claude 3.7 sonnet (Feb 25th, 2025)提示词,Claude 4 结合了推理模型的优势,提示工程的策略偏好呈现出从“规则驱动”到“原则引导”的转变。

因为 Claude 4 Opus 和 Sonnet 同时都支持扩展思考(即推理模型),有些很明显的变化:

- 更典型的推理模型提示策略:倾向使用更统括性的提示引导,让模型针对具体的用户 Prompt 进行适应。减少了很多明确、具象的规则要求。

- 充分利用模型的多步推理能力:比如用户纠错时,可以进行自我思考确认;拒答时可以先思考哪些可回答,哪些不行。

- 对特定知识进行强调:对于那些具有高度确定性、易出错且社会影响较大的事实性信息,进行硬提示。比如美国大选结果被直接写在了系统提示中,确保回答相关问题时不出错。

- 聚焦核心能力,淡化冗余“人设”:3.7 的时候还在强调智慧、善良,4 的时候基本不提性格。过于强调性格特质,有时反而可能引入不必要的对话“噪音”,或导致模型在表达上过于“拟人化”,从而影响信息传递的效率和专业度。

推理模型带来了多步思考,更强的原则泛化与问题分析能力,提示词工程也从最初的“精确指令编程”逐渐向“原则引导”和“AI 的认知塑造”转变:

- 推理模型的提示,可能会更抽象和概念化:更侧重于定义模型的“世界观”、“价值观”和“解决问题的元策略”。

- 人-AI 协同更紧密:提示词可能不仅是给模型的指令,也包含了模型如何与用户进行更有效协作的策略。

结尾

结尾

Anthropic 再次履行了他们“定期对外更新 Claude AI 的核心系统提示词”的约定,在推理模型成为主流既定路线后,给出了新的提示工程范例。

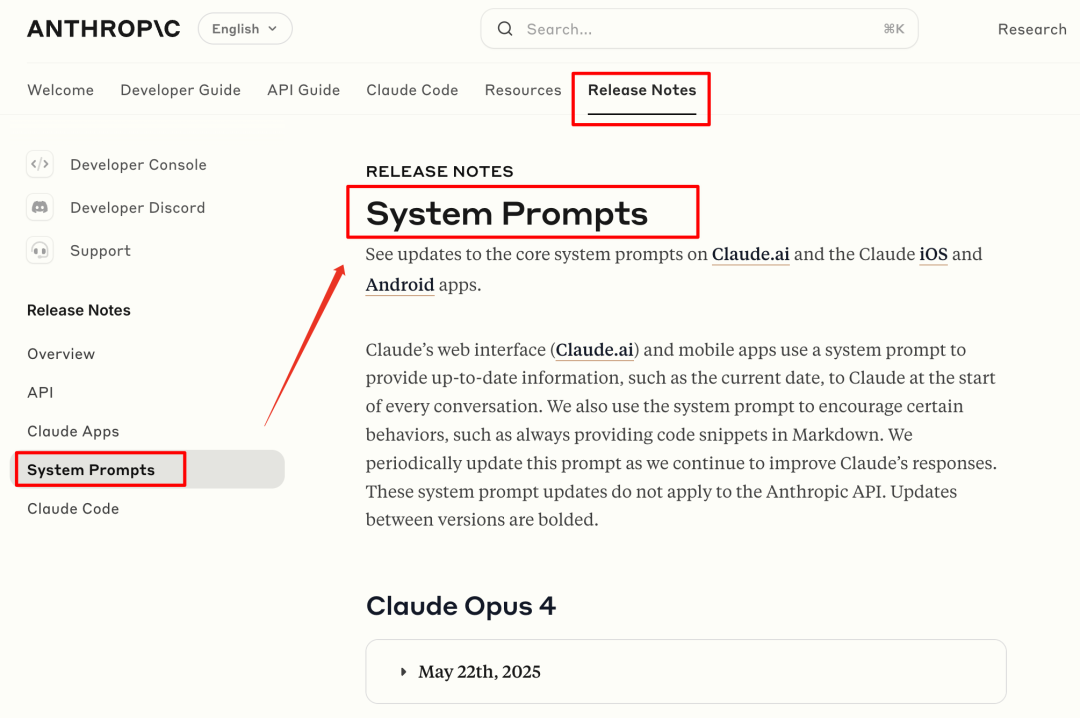

你依然可以在 Anthropic/Release-Notes/System-Prompts 中找到往期开源的更多系统提示词,涵盖了从 Claude 3 Haiku 到现在所有的模型。

另外,为了方便你更好的学习,一泽Eze 整理了更多 Anthropic 的相关提示词学习资料:

Claude 官方用户手册-提示工程指南(有推理模型提示工程的更新):https://docs.anthropic.com/en/docs/build-with-claude/prompt-engineering/overview

Anthropic 的三位顶级提示工程专家聊《如何当好的提示词工程师》:https://mp.weixin.qq.com/s/VP_auG0a3CzULlf_Eiz1sw

往期 Claude AI 核心系统提示词:https://docs.anthropic.com/en/release-notes/system-prompts

Claude 官方提示库:https://docs.anthropic.com/en/prompt-library/library

本文由人人都是产品经理作者【一泽Eze】,微信公众号:【一泽Eze】,原创/授权 发布于人人都是产品经理,未经许可,禁止转载。

题图来自Unsplash,基于 CC0 协议。