在人工智能的发展历程中,曾经的AI常常因缺乏逻辑而“瞎编乱造”,给出令人啼笑皆非的答案。然而,如今的AI已经学会了“边想边说”,能够像人类一样逐步推理并得出结论。这一切的转变,都得益于“思维链”(Chain of Thought,简称CoT)技术的出现。本文将带你深入了解思维链如何让大模型变得更聪明,从技术原理到实际应用,探索AI从“语言模仿器”向“类人智能”的关键进化路径。

还记得几年前,人工智能还在 “答非所问” 的阶段。

你问它:“一个人一天吃三顿饭,两个人吃几顿?”

它可能认真地答你:“六顿!”

你一脸问号:逻辑在哪?

但到了今天,它会像个小学数学老师一样,认真地告诉你:

“一个人吃三顿,两个人各吃三顿,所以一共是 2 × 3 = 6 顿饭。”

这不是 AI 变聪明了,而是它学会了 “边想边说”,这,就是今天要讲的主角 —— 思维链(Chain of Thought,简称 CoT)

思维链(Chain of Thought,简称 CoT)

一、什么是 “思维链”?一句话解释:把脑子打开说话!

一、什么是 “思维链”?一句话解释:把脑子打开说话!

思维链(CoT)是一种让大模型变得更像人的方法:

不再 “啪” 地就给你一个答案

不再 “啪” 地就给你一个答案 而是像人一样,一步步推理,逐步得出结论

而是像人一样,一步步推理,逐步得出结论

举个例子:

举个例子:

问题:如果火车以每小时 60 公里的速度行驶,从 A 城到 C 城 90 公里,要多久?

传统 AI 答:90 公里 or 3 小时

思维链 AI 答:

距离 90 公里,速度 60 公里 / 小时

时间 = 距离 ÷ 速度 = 90 ÷ 60 = 1.5 小时

这就像你在考试时的 “解题步骤”,模型不光给你答案,还把思考过程写清楚。

二、思维链的诞生:让 AI 不再 “装懂”

二、思维链的诞生:让 AI 不再 “装懂”

2022 年,Google 研究团队发表了一篇经典论文(Wei et al.):

只需加一句提示词:“Let’s think step by step.”

只需加一句提示词:“Let’s think step by step.” 模型的数学题正确率立刻从 17.9% 提升到 57.1%!

模型的数学题正确率立刻从 17.9% 提升到 57.1%!

这一下,整个 AI 圈都沸腾了!

人们突然发现:原来 AI 不是不会,是你没教它怎么想!

这一突破性成果在 GSM8K 数学问题数据集上得到验证,证明思维链提示能显著提升模型的推理能力。

三、2025 年:思维链已经 “内化” 进大模型了

三、2025 年:思维链已经 “内化” 进大模型了

从 GPT-3.5 到 GPT-4 Turbo,从 Claude 3.7 Sonnet 到文心一言 4.0,从通义千问 2.1 到 DeepSeek R1……

2025 年,所有主流大模型都已内化思维链机制:

有了思维链,大模型就不再只是 “语言模仿器”,而是具备了 “类人类推理能力”。

四、思维链的三大打开方式

四、思维链的三大打开方式

不同任务,适用不同的 “思维链流派”

明示型思维链(Chain-of-Thought Prompting)

- 提示词示例:“请一步步推理后作答”

简单好用

简单好用 有时不稳定,依赖提示技巧

有时不稳定,依赖提示技巧

树状思维链(Tree-of-Thought, ToT)

- 模型像人一样 “发散思维”,尝试多个解法,再投票决定答案

类似 “玩策略游戏” 时的决策过程,已在复杂逻辑推理任务中应用

类似 “玩策略游戏” 时的决策过程,已在复杂逻辑推理任务中应用

反思型思维链(Reflection)

- Claude 3.7 Sonnet 引入:模型自己检查哪里错了,再改

- 模拟人类的 “刷题 – 错题 – 复盘” 过程,支持自我修正

五、为什么大模型离不开思维链?

五、为什么大模型离不开思维链?

因为它们本来就不 “擅长思考”,更像 “复读机”。

有了思维链,AI 的几个致命短板被补上了:

六、思维链还可以怎么玩?高级技巧来啦!

六、思维链还可以怎么玩?高级技巧来啦!

一致性思维链(Self-Consistency CoT)

一致性思维链(Self-Consistency CoT)

- 让模型生成多个答案路径

- 然后 “多数投票” 决定最终答案

提升可靠性,防止某一思路偏差影响全局,在数学问题中准确率提升显著

提升可靠性,防止某一思路偏差影响全局,在数学问题中准确率提升显著

自动化思维链(Auto-CoT)

自动化思维链(Auto-CoT)

- 机器自动归类问题 → 自动生成示例 → 自动训练模型

- 让模型 “自己教自己”,减少人工标注依赖

外部验证思维链(CRITIC)

外部验证思维链(CRITIC)

- 模型答题后,引入计算器 / 搜索 / 工具来验证每一步

- 这就像 AI 有了自己的 “查资料”+“验算” 能力,如 Cursor 在代码生成中调用外部工具验证逻辑

七、未来趋势:CoT+X 是大模型的必经之路

七、未来趋势:CoT+X 是大模型的必经之路

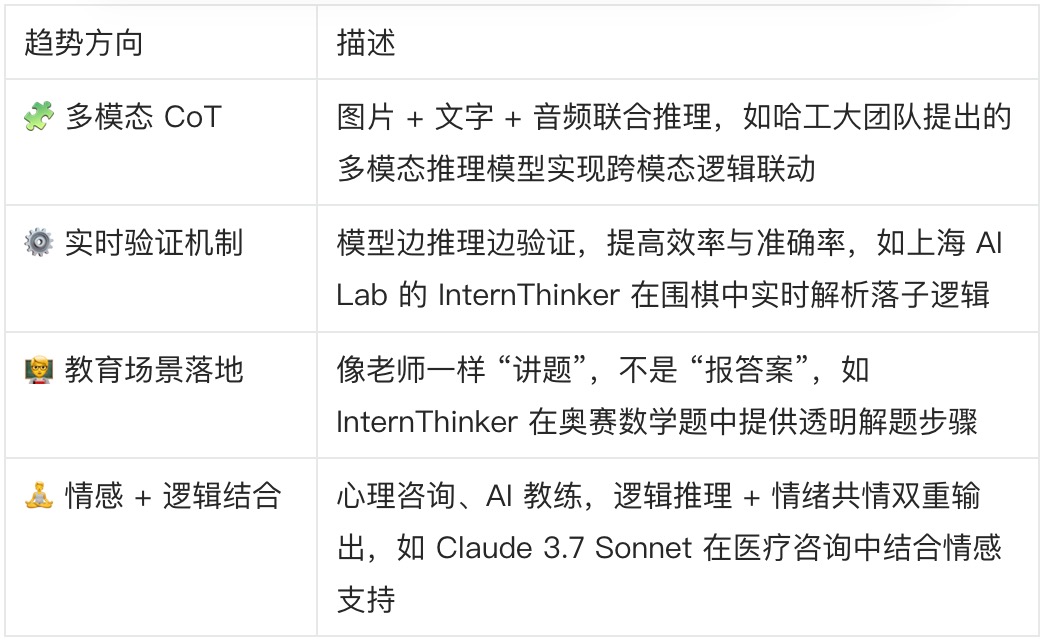

未来几年,思维链将在以下方面大展拳脚:

八、真实案例:CoT 已经在这些地方火起来了!

八、真实案例:CoT 已经在这些地方火起来了!

教育辅导场景

教育辅导场景

AI 像老师一样写解题步骤,而不是只给答案

上海 AI Lab 的 InternThinker 在奥赛级数学题中,不仅给出答案,还通过自然语言讲解每一步推理过程,帮助学生理解逻辑链条。

医疗与法律领域

医疗与法律领域

模型输出方案 → 提供清晰推理链 → 专家再判断采纳与否

在法律领域,Claude 3.7 Sonnet 能生成法律条文推理路径,辅助律师分析案件逻辑;在医疗领域,多模态 CoT 模型可结合医学影像和文本数据,为诊断提供可追溯的推理依据。

编程与工具生成

编程与工具生成

不仅能写代码,还能解释为什么这么写 + 每一步含义

Cursor 等新一代编程工具结合思维链,可实时分析代码上下文,生成带解释的代码建议,并调用外部工具验证逻辑,显著提升开发效率。

九、总结:思维链,是 AI 变聪明的第一步

九、总结:思维链,是 AI 变聪明的第一步

一句话总结:

思维链不是让 AI 会 “答”,而是让它学会 “想”。

这不仅是 AI 的一小步,更是通向 “类人智能” 的关键路径:

让 AI 能一步步推理

让 AI 能一步步推理 能解释每一个决策

能解释每一个决策 能修正自己的错误

能修正自己的错误 更容易被人类信任与共处

更容易被人类信任与共处

在 AI 逐步从工具进化为 “思维助手” 的今天,思维链已经不再是 “高级技巧”,而是大模型的核心能力。随着多模态融合、实时验证等技术的发展,思维链将进一步推动 AI 向通用智能迈进。

本文由 @乱七八看 原创发布于人人都是产品经理,未经许可,禁止转载。

题图来自 Unsplash,基于 CC0 协议。